最近、インターネットはびっくりするような画像に揺さぶられています。ぽわぽわのジャケットを着たローマ法王や、習近平の手に膝をついてキスするウラジミール・プーチンなど。しかし、これらの出来事はどれも事実ではありません。ディープフェイクと呼ばれる高度なAI技術の産物なのです。

AI画像生成ツールで作成された、白い大きなコートを着たフランシスコ法王の偽写真に、多くのネットユーザーが騙されました。

AI画像生成ツールで作成された、白い大きなコートを着たフランシスコ法王の偽写真に、多くのネットユーザーが騙されました。

中国の指導者がロシアを国賓訪問した際、ロシアのプーチン大統領がひざまずき、習近平の手にキスをするAI生成画像がSNSで拡散されました。架空のシーンを現実のものと信じる人もいた模様。

これらのフェイク画像や動画は、AIがいかに簡単に現実とフィクションの境界を曖昧にしてしまうかを象徴しており、広範囲に重大な影響が及ぶことが考えられます。

[ 安心のVPNトライアルでオンライン活動を保護し、個人情報を保護しましょう ]

AIが記憶方法をどのように変えつつあるのか、そしてディープフェイクが誤った事実を真実と思い込んで覚えてしまう現象(マンデラ効果)に寄与する可能性があるのかについて、より詳しく見てみましょう。あなたが知っていると思っていたことをすべて疑ってみてください。

■目次

ディープフェイク - AIが作る合成技術

マンデラ効果とは?(自分の記憶を試せるクイズあり!)

ディープフェイクも一因?マンデラ効果の原因とは?

ディープフェイク由来の記憶の危険性

ディープフェイクを見破る10の方法

ディープフェイク - AIが作る合成技術

ディープフェイクとは、本来、AIにおける深層学習(ディープラーニング)技術を使用して、二つの写真や動画の一部をを入れ替える技術のことです。近年では、その合成されたメディアコンテンツそのものを指すことも多くなっています。ディープフェイクは、動画の中の人の顔などを入れ替え、本来行っていない動作や言動をしているかのように見せることができます。

ディープフェイクの合成メディアに多く触れていくうちに、私たちは真実ではないことを真実だと思い込んで記憶している可能性があります。俗に言う、マンデラ効果です。

マンデラ効果とは?

この言葉は、南アフリカの反アパルトヘイト革命家であり政治家であったネルソン・マンデラにちなんで命名されました。1980年代に獄中で亡くなったと多くの人が信じていましたが、実際にはそうではなかったという証拠がたくさんあります。実際には、1990年に釈放され、アフリカ南部の国の大統領となり、最終的に2013年に亡くなりました。

「マンデラ効果」はその後、ブランド名のスペル、歌の歌詞、映画やテレビ番組の筋書き、歴史的事件の詳細など、さまざまな出来事や詳細を誤って記憶してしまうことを表す言葉として使われるようになりました。

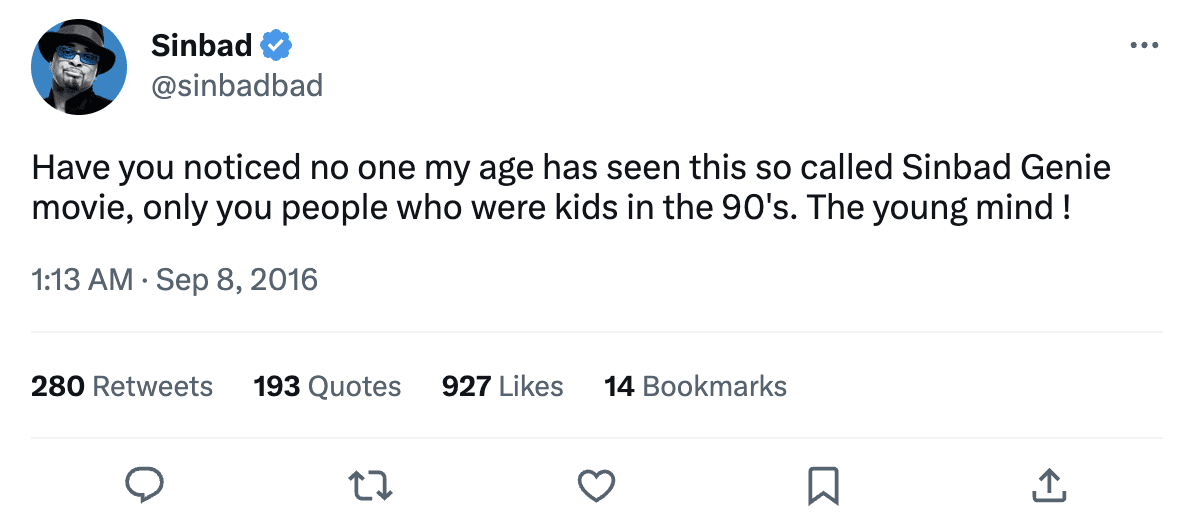

マンデラ効果の実例として、1990年代の人気コメディアン、シンドバッドがいます。多くの人が、シンドバッドが精霊を演じて2人の子供を助ける『シャザーム』(2019年のスーパーヒーロー映画『シャザーム!』とは別物)という映画を覚えていると主張しています。しかし、そのような映画は作られていません。一番近いのは、シャキール・オニールが精霊として出演した『カザーム』という映画です。

『シャザーム』の存在を証明する証拠がないにもかかわらず、多くの人が『シャザーム』を見たと確信し、筋書きや登場人物、映画のポスターの形まで詳細に覚えています。シンドバッド自身は精霊を演じたことはないと言っているにもかかわらず、この映画のアイデアは人々の記憶に深く刻まれ、映画が存在することを完全に確信させています。

ここで [クイズ]! あなたの記憶力は大丈夫?マンデラ効果クイズで、自分の記憶を試そう

[evpn_typeform id="Oa0H6HOH"]

ディープフェイクも一因?マンデラ効果の原因とは?

マンデラ効果の原因は完全には解明されていませんが、それを説明しようとするいくつかの説があります。一つは、誤った情報、誤った解釈、暗示の力によって、出来事や事実を間違って記憶してしまう「偽りの記憶」の結果であるというものです。また、より飛躍した説としては、マトリックスやパラレルワールドの不具合によるもので、現実の異なるバージョンを体験した可能性があるというものもあります。

心理学者は、マンデラ効果は、私たちの脳の仕組みに起因しているのではないかと考えています。具体的には、人は他人の言葉や自分の既成概念に影響されて、物事を間違って記憶してしまうことがあるのです。これを「認知バイアス」と呼びます。例えば、SNS上で多くの人が「あることが起こった」と発言すると、たとえそうでなくても、本当にそのように起こったと思い込んでしまうことがあります。

マンデラ効果は最近起こったことではなく、ほとんどがポップカルチャーに関するものですが、ディープフェイクの台頭は、偽の情報がより速く、より簡単に広まることを意味し、実際には起こらなかったことを記憶し始める人が増えるかもしれません。

これは、私たちがオンラインで目にする情報を信頼できるのか、AIを使って画像や動画を操作してもいいのか、私たちの記憶や信念を形成するためにテクノロジーがどれだけの力を持つべきなのかという重要な問題を提起しています。

ディープフェイク由来の記憶の危険性

2019年時点で、オンラインで検出されたディープフェイクは15,000件未満でした。現在、その数は数百万にのぼり、世界経済フォーラムによると、専門家が作成したディープフェイクの数は年率900%で増え続けています。

ディープフェイクの最も懸念される点は、フェイクニュースやプロパガンダの作成、金銭的利益を得るためのなりすましなど、悪意ある目的に使用される可能性があることです。また、この技術はディープフェイクポルノの作成にも利用されており、個人の搾取や悪用される可能性が懸念されています。

また、ディープフェイクは、その高いリアリティから、実際には起こっていないことを見たように思わせる力があります。その結果、事実と異なるシナリオを事実として記憶してしまう可能性があるのです。

ここでは、ディープフェイクがマンデラ効果に寄与する例と、それに伴う危険性を紹介します。

フェイクニュース記事の作成

ディープフェイクは、完全に捏造されたものであっても、人々が真実だと信じてしまうほどリアルな偽ニュースを作成するために使用される可能性があります。例えば、テロや自然災害などの偽ニュースは、特定の社会政治的な意図を推進することのみを目的として作成されます。このようなニュースをディープフェイクで作成すると、あたかも本物のニュースのように、説得力のある映像や音声で表現することができます。その結果、歴史や出来事を歪んだ形で後世に伝えることになりかねません。

政治的な意見の揺さぶり

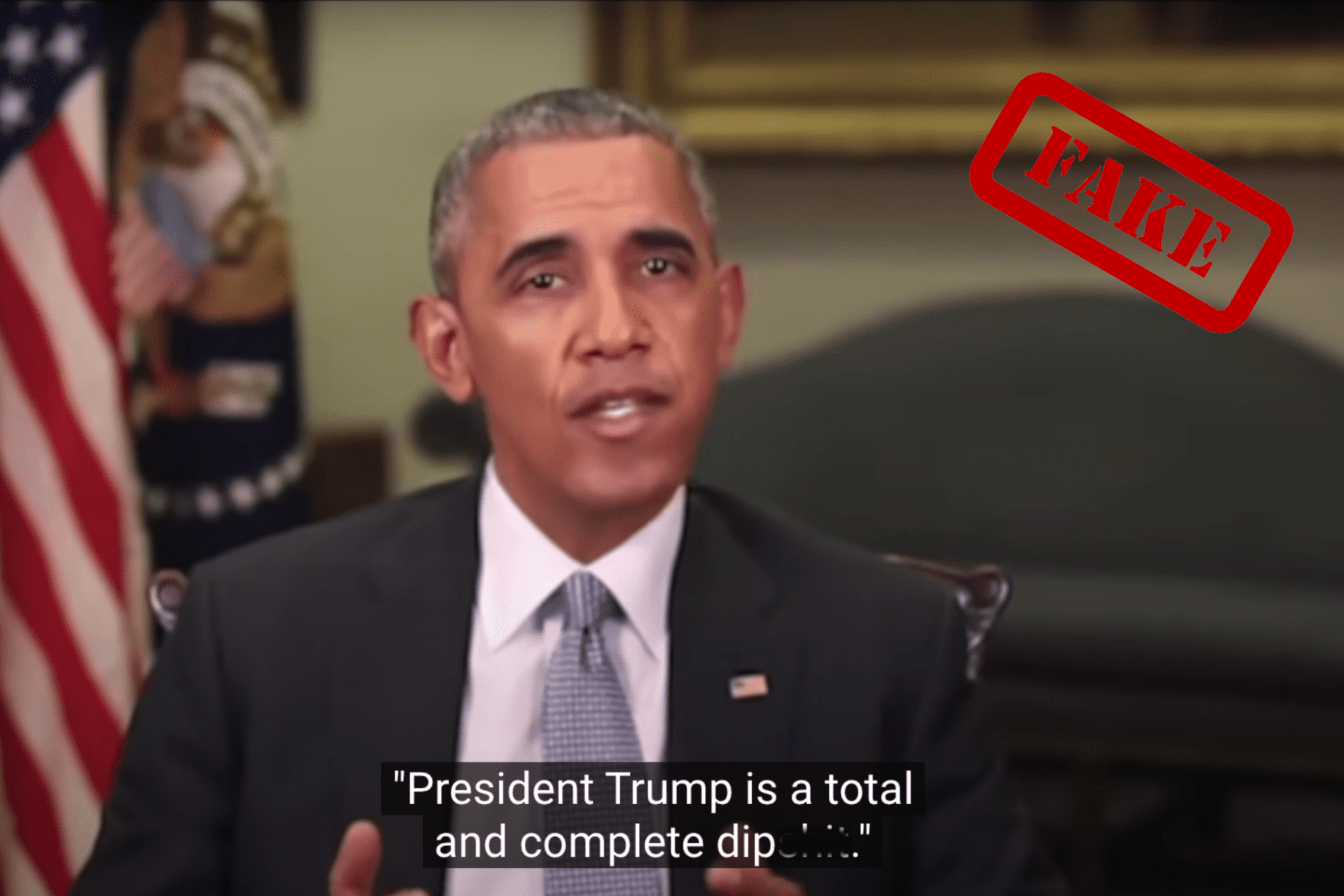

2018年の中間選挙の数ヶ月前、バラク・オバマ氏が当時の大統領ドナルド・トランプ氏を悪者扱いするディープフェイク動画が流行しました。これは、オスカー受賞監督であるジョーダン・ピールが、ユーザーがオンラインで遭遇した素材を信用することへの警告として作成したものです。皮肉なことに、トランプ大統領の支持者の多くがこの動画を本物だと信じ、大勢の支持者がソーシャルメディアで怒りを表明したため、この動画は裏目に出てしまいました。 もし、政治家候補や公人が実際には起こりえない言動をする同様のディープフェイク動画に十分な説得力があれば、民主主義の機能や人々の制度に対する信頼に有害な影響を及ぼす可能性があります。

もし、政治家候補や公人が実際には起こりえない言動をする同様のディープフェイク動画に十分な説得力があれば、民主主義の機能や人々の制度に対する信頼に有害な影響を及ぼす可能性があります。

例えば、ソーシャルメディアや様々なニュースを通じて、自国の政治家候補の説得力のあるディープフェイク動画に触れる人が増えれば、誤った記憶が広まり、真実として受け入れられるようになるかも知れません。そうすると、選挙で誰に投票するか、誰をリーダーに指名するかということが変わってきます。

プロパガンダキャンペーンの推進

ディープフェイクを使ったプロパガンダキャンペーンは、世論操作や国家が支援するグループに関する偽情報の流布に利用され、最終的に現実を歪曲することにつながります。例えば、現在進行中のロシアとの紛争に関連して、ウクライナ情報局は最近、ウクライナ大統領ウォロディミル・ゼレンスキー氏がウクライナ人に降伏を呼びかけているディープフェイク動画が出回っていることを警告しました。 多くのプラットフォームがこの動画を削除したにもかかわらず、Facebook、Reddit、TikTokなどのソーシャルメディアに掲載され続け、人々の間に不和をもたらし、真実を見極めることを難しくしています。

多くのプラットフォームがこの動画を削除したにもかかわらず、Facebook、Reddit、TikTokなどのソーシャルメディアに掲載され続け、人々の間に不和をもたらし、真実を見極めることを難しくしています。

歴史的映像の改ざん

ディープフェイクは、政治的な演説や重要なイベントの映像など、歴史的な映像を改変し、実際に何が起こったのか人々の記憶を変えるような使い方をする可能性があります。その結果、過去に何が起こったのかが分からなくなり、歴史的な記録やメディアに対する信頼が失われ、結果的に陰謀論につながる可能性があります。

例えば、月面着陸です。現在でも、月面着陸は捏造されたもので、実際には起こらなかったと主張する人がいます。ディープフェイクを利用すれば、このような誤った物語を補強する説得力のあるビデオや音声記録を作成し、歴史的出来事の真偽に対する懐疑心や不信感を強めることができるのです。

ソーシャルメディアコンテンツの操作

ソーシャルメディアへのアクセスが容易になった今、ディープフェイクは、有名人や公人、インフルエンサーがイベントに出席しているように見せかけたり、特定の商品を支持しているように見せかけたりする偽の投稿に使われる可能性があります。ディープフェイクによる偽の情報を野放しにすることで、社会の二極化を助長し、偽情報キャンペーンのための肥沃な土壌を作ることになります。その結果、民主主義と社会的結束に不可欠なコミュニケーションツールとしてのソーシャルメディアの信頼性が損なわれてしまうのです。

科学的根拠の捏造

ウイルスの起源から医学の飛躍的進歩まで、ディープフェイクは、真実でない主張や仮説を支持するための偽の科学的証拠を作り出すために使われることがあります。例えば、気候変動が人間の活動によって引き起こされているという圧倒的な科学的証拠があるにもかかわらず、気候変動に関する偽情報を広めようとする人たちがいます。これは、地球温暖化のような重要な問題に対する脅威となります。

ディープフェイクは、気候変動が外的要因によって引き起こされたとする偽の科学的証拠を作り出すことができます。これは重大な意味を持ちます。気候変動の原因について懐疑的な意見が広まれば、政策立案者は気候変動に対処するための行動を起こしにくくなる可能性があります。その結果、世論がさらに分裂し、この緊急課題にどう取り組むかについてのコンセンサスを得ることが難しくなる可能性があります。

偽のアリバイ作り

さらに、ディープフェイクは、裁判における偽の自白や供述を作成したり、犯罪者のアリバイ作りのために監視カメラの映像を操作したりするのにも利用される可能性があります。このような場合、犯罪にまつわる誤った物語が作られ、人々は、a)犯人は犯罪を犯していない、b)無実の人が犯罪を犯した、と考えるようになる可能性があります。このような虚偽のシナリオは、時間の経過とともに、事件に関わった人々の記憶に定着し、事実であると信じられるようになる可能性があります。

仮に、ある有名な刑事事件で、弁護団が被告人が犯行時刻に別の場所にいたことを示す非常にリアルなディープフェイク動画を作成したとします。その動画は広く拡散され、多くの人が「被告人が殺人を犯すはずがない」と考えるようになります。その後、その動画がディープフェイクであることが証明され、被告人が有罪となったとしても、その動画の記憶により、被告人が無罪であったと信じ続ける人が出てくるかも知れません。

ディープフェイクを見破る10の方法

ディープフェイクが誤った記憶を作り出す問題に立ち向かうためには、私たち全員が消費する情報に対して批判的かつ懐疑的であり続けること、そしてテクノロジー企業や政府が協力してディープフェイク動画の検出と拡散防止のためのソリューションを開発することが不可欠です。

その間に、ディープフェイクを見抜く方法を学び、誤った情報や誤った記憶の拡散から身を守れるようにしましょう。

1. 顔の歪みと変形

● 顔の照明や3D変換の歪みを探す

● 特に頬、額、眉毛、顔の毛の質感に矛盾がないか確認する

2. リアルな目や唇の動き

● 影や目の色、顔のほくろやまばたきの動きなどがリアルに見えるかどうか確認する

● 被写体の唇が自然で、その人自身のものであるかどうか確認する

3. 被写体の動きや仕草

● 映像の中の被写体の動きやしぐさに注目する

● 不格好に見えるか、完璧すぎる場合には注意する

4. 音声の解析

● 映像の中の音声をよく聞く

● AIが生成した音声や改変した音声を使用している可能性があるため、人工的な音声や歪みがあるかどうかを確認する

5. 照明や映り込みの不一致

● 環境や映像中の人物の位置と合致しない、照明や反射の不一致を探す

6. 映像コンテンツの検証

● 元の動画を探す、または他の事例を検索して内容を確認する

● Google Image Search、TinEye、SauceNAO、Bing Visual Searchなどのツールで逆画像検索を行う

7. 文脈の分析

● 動画が投稿・共有された背景を確認する

● 信頼できる報道機関か、それともソーシャルメディア上の無差別な人物や疑わしい意図を持つ個人か、ビデオのオリジナルソースをチェックする

8. 不自然な状況や非常識な状況

● 有名人が常軌を逸した行動をとったり、政治家が物議を醸すような発言をするなど、常識では考えられないような状況を映した動画は疑ってみる

9. メタデータの確認

● 映像のメタデータを確認し、収録時間や場所など、映像の主張と一致しているかどうかを確認する

● メタデータは簡単に変更できるため、映像の真偽を判断する唯一の基準にはならないことに留意する

10. 最新情報の確認

● ディープフェイクを作るための技術は常に向上しており、今後、ディープフェイクを見抜くことが難しくなる可能性があることに留意する

● この分野の新たな展開についてできる限り最新情報を入手し、疑わしい、あるいは極めてニュース性の高い動画を共有・リアクションする際には、慎重を期す

ディープフェイクは単純にエンタメ性のあるコンテンツとして楽しめる一方で、政治、社会、個人の生活、そして人々の記憶にも影響を及ぼす一面があることが分かります。さまざまな情報が溢れる時代、ディープフェイクを見極める力をつけておきましょう。

ネット上で身を守るための第一歩を踏み出しましょう。リスクなしでExpressVPNをお試しください。

ExpressVPN を入手